| Скачать .docx |

Реферат: Энтропия сигналов

Контрольная работа

По курсу: Теория информации и кодирования

На тему: Энтропия сигналов

1. ЭНТРОПИЯ ОБЪЕДИНЕНИЯ

Объединение - совокупность двух и более ансамблей дискретных, случайных событий. С объединением связаны понятия условной, безусловной, совместной и взаимной энтропии.

1. Безусловная энтропия - среднее количество информации, приходящееся на один символ (рис. 1). Если Х – передаваемое, а У - принимаемое сообщения, то можно записать следующие соотношения:

|

X Y X Y

X Y X Y

Рис. 1. Безусловная энтропия

2. Условная энтропия - количество информации об источнике, когда известно, что принимается Y, или мера количества информации в приемнике когда известно, что передается X (рис. 2).

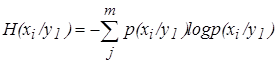

|

X Y X Y

Рис. 2. Условная энтропия

3. Совместная энтропия - среднее количество информации на пару пе-реданных и принятых символов (рис. 3).

H(X,Y) = H(Y,X) = H(X)+H(Y/X)= H(Y)+H(X/Y)= H(X)+H(Y)-H(X×Y).

4. Взаимная энтропия - энтропия совместного появления статистически-зависимых сообщений (рис. 4).

H(X×?Y)=H(Y×X)=H(X)-H(X/Y)=H(Y)-H(Y/X)=H(X,Y)-H(X/Y)- H(Y/X).

X Y

Рис. 3 Совместная энтропия

X Y

Рис. 4. Взаимная энтропия

На практике чаще всего встречаются взаимозависимые символы и сообщения. Например, при передаче текстовых сообщений передаются не просто буквы, а слова, имеющие определенные смысловые значения. При этом, каждая буква, и сочетание букв имеют различные вероятности появления в тексте. Условная энтропия учитывает взаимосвязь событий через их условные вероятности.

Рассмотрим схему рис. 5:

![]()

![]()

|

|

Рис. 5. Передача сообщений

Источник сообщений X - вырабатывает сообщения, элементами которого являются символы алфавита источника {x1 ,x2 ,...,xm } , вероятности появления на выходе которых равны p(x1 ), p(x2 ), ..., p(xm ) , при этом:

![]()

Энтропия источника представляет собой неопределенность появления на выходе источника сообщений символа первичного алфавита и определяется соотношением:

![]() ()

()

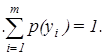

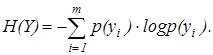

Приемник сообщений Y - принимает сообщения, элементами которого являются символы алфавита приемника {y1 ,y2 ,...,ym } , вероятности появления на входе которых равны p(y1 ), p(y2 ),..., p(ym ), при этом:

Энтропия приемника представляет собой неопределенность появления на входе приемника сообщений символа после его появления на выходе источника и определяется соотношением:

(2)

(2)

Если в канале связи отсутствуют потери информации (нет помех, ис-кажений и т. д.), то символу xi соответствует символ yi . В противном случае xi может быть принят как любой из возможных y1 ,y2 ,...,ym , с соответствующими вероятностями.

При отсутствии потерь: H(X) = H(Y). При наличии помех они уничто-жают часть информации. При этом потери информации можно определить через частные и общую условную энтропию.

Вычисление общей условной энтропии удобно производить с помощью канальных матриц ( матрицей переходных состояний).

Потери информации в канале можно оценивать со стороны источника или приемника сообщений.

Рассмотрим порядок определения потерь со стороны источника (известен передаваемый сигнал). При этом, условная вероятность p(yj /xi ) означает вероятность того, что при передаче сообщения xi получено сообщение yj . Канальная матрица имеет вид, приведенный в табл. 1.

Таблица 1

X |

y1 y2 ym |

x1 x2 xm |

p(y1 /x1 ) p(y2 /x1 ) . . . p(ym /x1 ) p(y1 /x2 ) p(y2 /x2 ) . . . p(ym /x2 ) p(y1 /xm ) p(y2 /xm ) . . . p(ym /xm ) |

При этом:

.

.

Вероятности, расположенные на диагонали характеризует вероятность правильного приема, остальные – ложного, чем они расположены дальше от диагонали, тем они меньше. При отсутствии помех в канале связи элементы матрицы, расположенные по диагонали, равны единице, а все остальные равны нулю. Канальные матрицы всегда квадратные, т. к. количество передаваемых сигналов, равно количеству принятых, хотя вероятность прохождения отдельных сигналов может быть равна нулю.

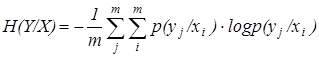

Потери информации, вызванные действием помех, определяются с помощью условной энтропии. Для равновероятных сигналов на выходе источника общая условная энтропия вычисляется по формуле:

. (3)

. (3)

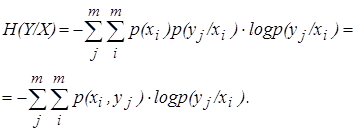

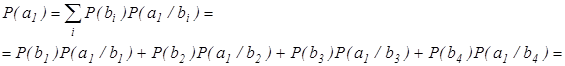

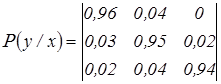

Для не равновероятных сигналов на выходе источника общая условная энтропия вычисляется по формуле:

(4)

(4)

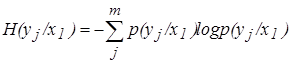

Частная условная энтропия определяет потери информации, приходящиеся на долю какого – либо конкретного сигнала (например, потери для сигнала x1 )

. (5)

. (5)

При отсутствии помех вероятность получения правильного сигнала станет безусловной, а условная энтропия будет равна нулю.

Для исследования канала со стороны приемника (известен полученный сигнал) - условная вероятность p(xi /yi ) означает вероятность того, что при приеме сообщения yi было передано сообщение x i .

Канальная матрица имеет вид, приведенный в табл. 2.

Таблица 2

X |

y1 y2 ym |

x1 x2 xm |

p(x1 /y1 ) p(x1 /y2 ) . . . p(x1 /ym ) p(x2 /y1 ) p(x2 /y2 ) . . . p(x2 /ym ) p(xm /y1 ) p(xm /y2 ) . . . p(xm /ym ) |

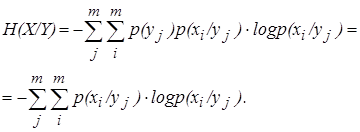

Вероятности расположения на диагонали характеризует вероятность правильной передачи, остальные – ложной. Для равновероятных сигналов на входе приемника общая условная энтропия вычисляется по формуле:

. (6)

. (6)

Для не равновероятных сигналов на входе приемника общая условная энтропия вычисляется по формуле:

( 17)

( 17)

Частная условная энтропия, определяющая потери, приходящиеся на долю сигнала y1 , равна:

. (8)

. (8)

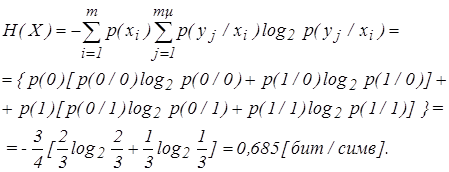

Пример 1. Вычислить энтропию источника сообщений, выдающего два символа 0 и 1 с вероятностями p(0)=3/4, p()=1/4 и условными вероятностями: p(0/0)=2/3, p(/0)=1/3, p(0/1)=1, p(/1)=0 , т. е. после 1 всегда идет 0.

Решение: Для случая взаимозависимых, не равновероятных элементов энтропия равна:

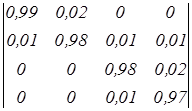

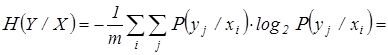

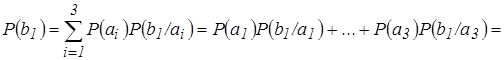

Пример 2. Определить энтропию источника сообщений, если вероят-ности появлений символов на входе приемника, равны: P(b1 )=0,1; P(b2 )=0,3; P(b3)=0,4, P(b4 )=0,2 а канальная матрица имеет вид:

P(a/b)

= .

.

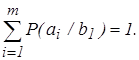

Сумма вероятности при одноименных условиях равна![]()

Решение: Определим энтропию источника

.

.

= 0,1 × 0,99+0,3 × 0,2+0,4 × 0=0,105;

![]() = 0,1

×

0,01+0,3

×

0,98+0,4

×

0,01+0,

×

2

×

0,01=0,301;

= 0,1

×

0,01+0,3

×

0,98+0,4

×

0,01+0,

×

2

×

0,01=0,301;

![]() 0,1

×

0+0,3

×

0+0,4

×

0,98+0,2

×

0,02=0,396;

0,1

×

0+0,3

×

0+0,4

×

0,98+0,2

×

0,02=0,396;

![]() 0,1

×

0+0,3

×

0+0,4

×

0,01+0,2

×

0,97=0,198;

0,1

×

0+0,3

×

0+0,4

×

0,01+0,2

×

0,97=0,198;

Проверка:

![]() 0,105+0,301+0,396+0,198=1.

0,105+0,301+0,396+0,198=1.

При этом энтропия источника равна:

H(A)=-(0,105 × log 0,105+0,301 × log 0,301+0,396 × log 0,396+0,198 × log 0,198)=1,856 бит / симв .

Пример 3. Определить энтропию источника и условную энтропию сообщений, передаваемых по каналу связи, и состоящих из равновероятных символов, если влияние помех в канале описывается матрицей:

.

.

Решение: Для равновероятных символов в сообщении энтропия источника сообщений равна:

![]() бит/симв.

бит/симв.

Полная условная энтропия равна:

![]()

![]()

=![]()

![]()

бит/симв.

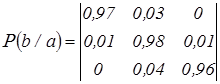

Пример 4. Определить энтропию приемника сообщений, если вероятности появления символов a1 , a2 и a3 на входе источника сообщений равны P(a1 )=0,5; P(a2 )=0,3 и P(a3 )=0,2, а канальная матрица имеет вид:

,

,

Решение: Энтропия приемника равна:

![]() .

.

Вероятности появления символов на входе приемника

![]() ;

;

![]() ;

;

![]() .

.

Проверка:

![]() .

.

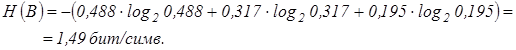

При этом:

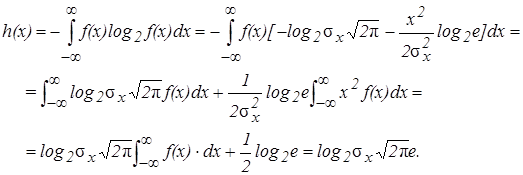

2. ЭНТРОПИЯ ИСТОЧНИКА НЕПРЕРЫВНЫХ СООБЩЕНИЙ

ДИФФЕРЕНЦИАЛЬНАЯ ЭНТРОПИЯ

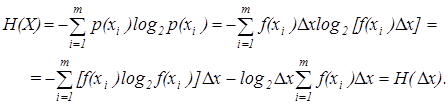

Для описания информационных свойств непрерывного источника (сигнала) используется понятие дифференциальной энтропии. Для ее получения воспользуемся формулой для энтропии дискретных сообщений. В соответствии с графиком функции плотности вероятности (рис. 6.) можно записать p(xi

) =![]() ?

. Где p(xi

) -

вероятность того, что x

лежит в пределах i

-го шага квантования.

?

. Где p(xi

) -

вероятность того, что x

лежит в пределах i

-го шага квантования.

|

f(x)

f(xi )

0 D x xi x

Рис. 6. График функции плотности вероятности

При этом, выражение для энтропии можно представить в виде

(9)

(9)

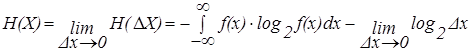

Переходим к пределу:

.

.

Полная энтропия источника непрерывных сообщений состоит из двух слагаемых, одно из которых определяется законом распределения, а второе является постоянной величиной, определяющей шаг квантования, который влияет на точность измерений. Этот член выражения определяет постоянную составляющую и исключается из рассмотрения.

Значение первого слагаемого определяется законом распределения и характеризует дифференциальную энтропию непрерывного источника (т. к. f(x) - плотность вероятности или дифференциальный закон распределения)

![]() , (20)

, (20)

Дифференциальная энтропия - часть энтропии источника непрерывных сообщений, которая зависит от плотности вероятности сигнала x(t) , выдаваемого источником.

Различные классы физических явлений и процессов подчиняются различным законам распределения. Непрерывные сигналы полностью характеризуются законами распределения (интегральным или дифференциальным). На любые реальные сигналы накладываются определенные ограничения, например: по средней мощности (нагрев аппаратуры); по мгновенной или пиковой мощности (перегрузки).

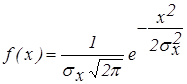

Так как дифференциальная энтропия зависит от плотности вероятности, определим, для какого закона она максимальна. Т. е. при каком распределении вероятности, сигнал заданной мощности имеет максимальную энтропию. Для нахождения максимального значения энтропии необходимо воспользоваться вариационной теоремой с использованием неопределенных множителей Лагранжа при условиях нормировки и неизменности среднего квадрата:

![]() ;

; ![]() .

.

При этом,

![]()

Решив уравнения, получим симметричный нормальный закон распределения

. (11)

. (11)

Если среднюю мощность не ограничивать

то получим равномерный закон распределения.

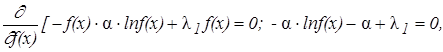

Определим дифференциальную энтропию для нормального распределения, т. е. сигнала с ограниченной средней мощностью. Полученное в результате решения вариационной задачи нормальное распределение является симметричным. Если в интеграле для дифференциальной энтропии произвести замену x = y-mx ,то интеграл не изменится, а значит, энтропия не зависит от математического ожидания и равна энтропии центрированной случайной величины.

![]() Определим максимальное значение для энтропии:

Определим максимальное значение для энтропии:

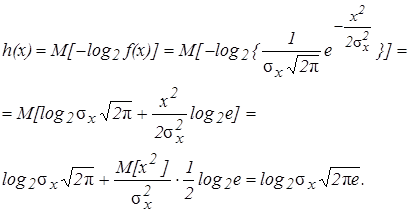

Дифференциальная энтропия для нормального распределения равна:

![]() (12)

(12)

Полная энтропия для нормального распределения равна:

. (13)

. (13)

Если учестьчто h(x) - это математическое ожидание функции [-log2 f(x) ] от случайной величины x с плотностью f(x), то можно записать.

В соответствии с центральной предельной теоремой нормальным законам распределения подчиняются широкий класс, так называемых гауссовых случайных процессов или реальных сигналов.

Белый шум - помеха с наиболее ''зловредными" свойствами , т. е. передает максимальное количество вредящих сведений при заданной средней мощности и позволяет упростить расчеты для наихудшего случая.

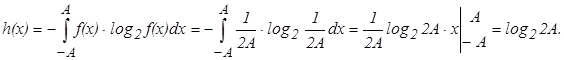

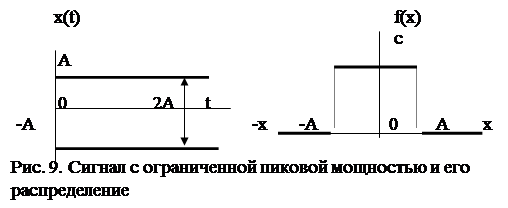

Для того чтобы сигнал с ограниченной пиковой мощностью имел максимальную информативность необходимо, чтобы он имел равномерное распределение (рис. 9). Определим дифференциальную энтропию для равномерного распределения, т. е. сигнала с ограниченной пиковой мощностью. Если P-пиковая мощность, то ![]() - максимальная амплитуда. Уравнение для дифференциальной энтропии с учетом ограничений имеет вид:

- максимальная амплитуда. Уравнение для дифференциальной энтропии с учетом ограничений имеет вид:

Дифференциальная энтропия для равномерного распределения равна:

![]() (14)

(14)

|

Полная энтропия сигнала с равномерным распределением равна:

![]() , (15)

, (15)

где m -число уровней квантования.

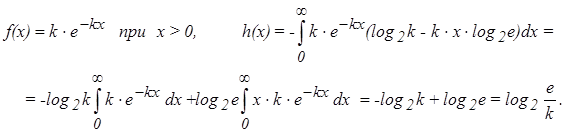

Определим дифференциальную энтропию для экспоненциального распределения. Это распределение широко используется для определения интенсивности отказов в радиоэлектронной аппаратуре

Полная энтропия для экспоненциального распределения равна:

![]() . (16)

. (16)

Список Литературы

1. Коганов А. В. Векторные меры сложности, энтропии, информации. “Математика. Компьютер. Образование”. Вып. 7, ч. 2, “Прогресс-Традиция”, М., 2000, с. 540 — 546

2. Яглом А. М., Яглом И. М. Вероятность и информация. М., 1957.

3. Шеннон К. Работы по теории информации и кибернетике. — М.: Изд. иностр. лит., 1963. — 830 с.

4. Волькенштейн М. В. Энтропия и информация. — М.: Наука, 1986. — 192 с.

5. Цымбал В. П. Теория информации и кодирование. — М.: Выща Школа, 1977. — 288 с.

6. Вероятностные методы в вычислительной технике. /Под ред. А.Н. Лебедева, Е.А.Чернявского. –М.: Высш. шк., 1986.

7. Седов Е.А. Взаимосвязь информации, энергии и физической энтропии в процессах управления и самоорганизации. Информация и управление. М., Наука, 1986.